Re: [閒聊] 日本模型展疑似出現3D掃描作品的小偷

目前的工具精度可能的確不太夠

但這個問題正以肉眼可見的速度被解決

最近有個新技術叫做神經輻射場 Neural Radiance Field 簡稱NeRF[1]

發表在ECCV 2020

可以透過若干張2D圖像生成新視角跟3D建模

主要原理是給定座標和視角

預測空間中各個點的RGB跟密度(可以想成透明度)

最後再沿著新視角把各點的值累加

就是新視角看到的樣子

拿個常見的demo來說

有大約100張不同視角的lego車圖

https://i.imgur.com/UvNuoyp.png

最後可以得到各種視角 精度也相當不錯

https://i.imgur.com/CP2dSUP.gif

那麼在現實場景的表現如何呢

Google在CVPR 2021發表了NeRF in the wild[2]

搜集各個景點大家拍的照片去訓練

解決一些遮擋 相機參數 光線不一致之類的問題

也做出不錯的成果(以下影片)

https://storage.googleapis.com/nerf-w-public/videos/sacre/flythrough_v3.webm

那為什麼這個工具還沒普及呢

主要原因是要訓練很久

原版的NeRF要訓練好幾個小時甚至好幾天

不過好消息是這個問題在上個月被Nvidia解決了[3]

把訓練時間壓到幾秒鐘

沒錯就是幾秒鐘

連render都可以做到幾10FPS

雖然說隨便拍個照錄個影片幾秒鐘得到3d模型還有待開發

但是可以預見這類型的應用即將走進移動端

在這個各大廠力押ARVR的時代

相信大家可以期待一下

Reference:

[1] Mildenhall, Ben, Pratul P. Srinivasan, Matthew Tancik, Jonathan T. Barron, Ravi Ramamoorthi, and Ren Ng. "Nerf: Representing scenes as neural radiance fields for view synthesis." In European conference on computer vision, pp. 405-421. Springer, Cham, 2020.

[2] Martin-Brualla, Ricardo, Noha Radwan, Mehdi SM Sajjadi, Jonathan T. Barron, Alexey Dosovitskiy, and Daniel Duckworth. "Nerf in the wild: Neural radiance fields for unconstrained photo collections." In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pp. 7210-7219. 2021.

[3] Müller, Thomas, Alex Evans, Christoph Schied, and Alexander Keller. "Instant Neural Graphics Primitives with a Multiresolution Hash Encoding." arXiv preprint arXiv:2201.05989 (2022).

※ 引述《S890127 (丁讀生)》之銘言:

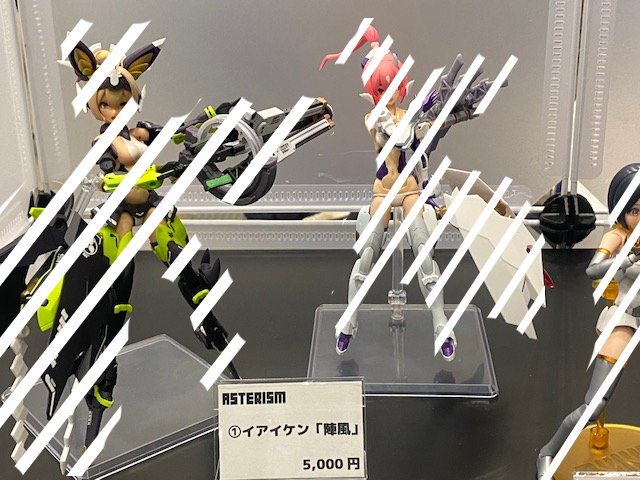

: 日本海洋堂主辦的 ワンフェス(Wonder Festival)

: 有參展人士在推特表示

: https://twitter.com/FLT44000/status/1490582145835798534

: 有拿著顯示奇怪畫面的智慧型手機的三人組(沒有說日文)到我的展區來。

: 現在才懂他們在幹嘛。

: 原來是深度感測(Depth Sensor)

: 原來是在用 LiDAR...

: 推主重現看到的手機畫面

: https://pbs.twimg.com/media/FK_tfoVaMAAYazX.jpg

: 根據底下網友的判斷,應該是被用手機掃描了展示品的 3D 模型

: 雖然不保證能複製到完全一樣的精細度,但沒付錢、未經許可

: 跑去掃描人家的商品模型,這算是犯罪了吧?

: 也許再過幾年技術變得更精密,真的會有人拿手機去掃描模型來自製了?

--

※ 發信站: 批踢踢實業坊(ptt.cc), 來自: 166.170.30.114 (美國)

※ 文章網址: https://www.ptt.cc/bbs/C_Chat/M.1644511132.A.562.html

→

02/11 00:40,

2年前

, 1F

02/11 00:40, 1F

推

02/11 00:41,

2年前

, 2F

02/11 00:41, 2F

→

02/11 00:41,

2年前

, 3F

02/11 00:41, 3F

→

02/11 00:41,

2年前

, 4F

02/11 00:41, 4F

推

02/11 00:42,

2年前

, 5F

02/11 00:42, 5F

推

02/11 00:42,

2年前

, 6F

02/11 00:42, 6F

推

02/11 00:42,

2年前

, 7F

02/11 00:42, 7F

→

02/11 00:42,

2年前

, 8F

02/11 00:42, 8F

→

02/11 00:43,

2年前

, 9F

02/11 00:43, 9F

→

02/11 00:44,

2年前

, 10F

02/11 00:44, 10F

→

02/11 00:47,

2年前

, 11F

02/11 00:47, 11F

→

02/11 00:49,

2年前

, 12F

02/11 00:49, 12F

推

02/11 00:50,

2年前

, 13F

02/11 00:50, 13F

→

02/11 00:52,

2年前

, 14F

02/11 00:52, 14F

推

02/11 00:57,

2年前

, 15F

02/11 00:57, 15F

推

02/11 01:38,

2年前

, 16F

02/11 01:38, 16F

推

02/11 01:44,

2年前

, 17F

02/11 01:44, 17F

→

02/11 02:32,

2年前

, 18F

02/11 02:32, 18F

→

02/11 02:33,

2年前

, 19F

02/11 02:33, 19F

b大您好

如果您對這方面有了解的話

是否能說明怎樣的精度符合建模師的要求

我們做這方面很歡迎跟其他領域的合作

畢竟了解並實際解決問題才有價值

→

02/11 06:49,

2年前

, 20F

02/11 06:49, 20F

→

02/11 06:53,

2年前

, 21F

02/11 06:53, 21F

→

02/11 06:59,

2年前

, 22F

02/11 06:59, 22F

→

02/11 06:59,

2年前

, 23F

02/11 06:59, 23F

→

02/11 06:59,

2年前

, 24F

02/11 06:59, 24F

→

02/11 07:04,

2年前

, 25F

02/11 07:04, 25F

→

02/11 07:04,

2年前

, 26F

02/11 07:04, 26F

M大您好

我不太清楚一般3D建模是用什麼格式

但是在NeRF原作中已經可以轉成mesh

最近也有一篇衍生作Point-NeRF可以轉成point cloud

透過NeRF建模應該是可行的?

※ 編輯: yiefaung (166.170.32.137 美國), 02/11/2022 08:21:36

→

02/11 09:26,

2年前

, 27F

02/11 09:26, 27F

→

02/11 09:31,

2年前

, 28F

02/11 09:31, 28F

→

02/11 09:31,

2年前

, 29F

02/11 09:31, 29F

→

02/11 09:31,

2年前

, 30F

02/11 09:31, 30F

→

02/11 10:03,

2年前

, 31F

02/11 10:03, 31F

→

02/11 10:03,

2年前

, 32F

02/11 10:03, 32F

原來如此 感謝解說

不過看到這個還是覺得大有可為哈哈

拭目以待了

※ 編輯: yiefaung (166.170.32.137 美國), 02/11/2022 10:51:52

討論串 (同標題文章)

本文引述了以下文章的的內容:

完整討論串 (本文為第 2 之 2 篇):